-

30/08/2016

-

317

-

446 bài viết

Đội nghiên cứu AI của Microsoft làm lộ lọt 38 terabyte dữ liệu mật

Vào thứ Hai, Microsoft cho biết họ đã thực hiện các biện pháp để khắc phục một sai sót bảo mật đáng lo ngại do lộ lọt 38 terabyte dữ liệu mật.

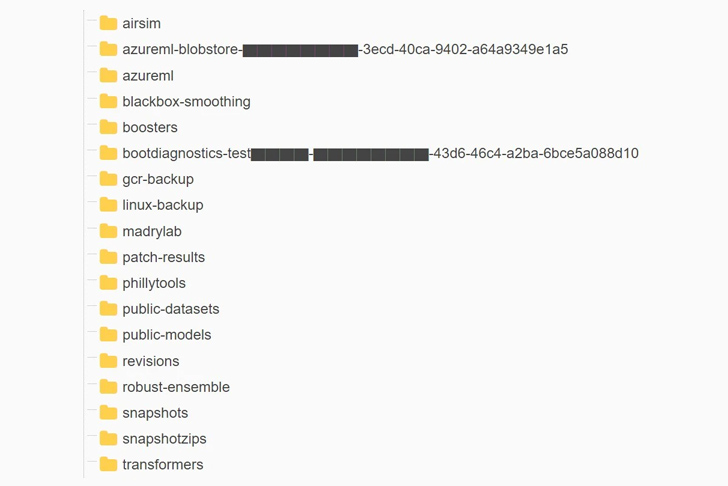

Vụ rò rỉ được phát hiện trên kho lưu trữ AI GitHub của công ty và có thể đã bị công khai khi một kho chứa data model mã nguồn mở được công bố. Dữ liệu bị lộ lọt cũng bao gồm một bản sao lưu đĩa máy tính cá nhân của hai cựu nhân viên chứa các thông tin bí mật, key, password và hơn 30.000 tin nhắn nội bộ trong Teams. Kho lưu trữ này có tên "robust-models-transfer" hiện không còn khả dụng nữa.

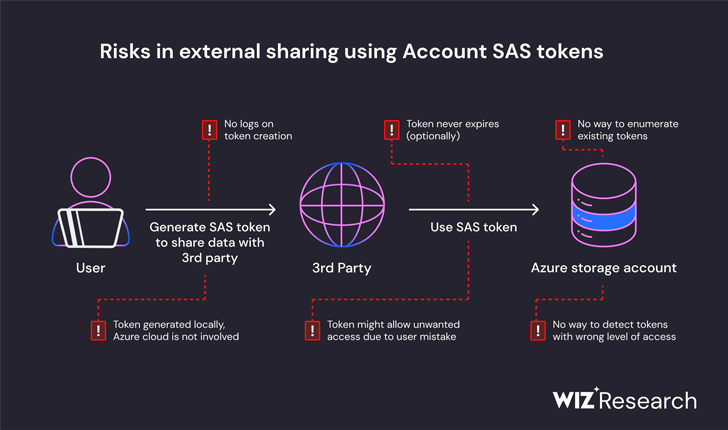

"Vụ lộ lọt xảy ra do tính năng phân quyền token SAS trên Azure cho phép người dùng chia sẻ dữ liệu một cách khó theo dõi và khó thu hồi" - các chuyên gia cho biết. Vấn đề này đã được báo cáo cho Microsoft vào ngày 22 tháng 6 năm 2023.

Cụ thể, tệp README.md của kho lưu trữ hướng dẫn các nhà phát triển tải các mô hình từ Azure Storage URL đã cho phép truy cập vào toàn bộ tài khoản lưu trữ, từ đó làm lộ lọt dữ liệu riêng tư.

"Ngoài phạm vi truy cập quá phân quyền, mã thông báo cũng đã được cấu hình sai để cho phép quyền "kiểm soát đầy đủ" thay vì chỉ quyền đọc" - các nhà nghiên cứu nói thêm - "Nghĩa là, một kẻ tấn công không chỉ có thể xem tất cả các tệp trong tài khoản lưu trữ, mà còn có thể xóa và ghi đè lên các tệp hiện có".

Microsoft cho biết họ không tìm thấy bất kỳ dấu vết nào về việc dữ liệu của khách hàng đang bị tiết lộ trái phép và "không có các dịch vụ nội bộ khác nào bị đe dọa do vấn đề này". Họ cũng nhấn mạnh rằng khách hàng không cần thực hiện bất kỳ hành động nào để bảo vệ mình khỏi các cuộc tấn công.

Microsoft cũng lưu ý rằng họ đã thu hồi mã SAS và chặn tất cả quyền truy cập từ bên ngoài vào tài khoản lưu trữ. Vấn đề đã được giải quyết hai ngày sau khi được tiết lộ.

Để giảm thiểu các rủi ro tương tự trong tương lai, hãng đã mở rộng dịch vụ quét mã thông báo bí mật bao gồm bất kỳ mã thông báo SAS nào có thời gian hết hạn hoặc quyền hạn quá phân quyền.

Các nhà nghiên cứu cho hay: "Do việc thiếu bảo mật và quản trị đối với các mã thông báo Account SAS, chúng nên được coi là nhạy cảm như chính khóa tài khoản. Do đó, nên tránh sử dụng Account SAS cho việc chia sẻ công khai. Những sai sót trong việc tạo mã thông báo có thể không được phát hiện và dẫn đến tiết lộ dữ liệu nhạy cảm."

Đây không phải lần đầu mà các tài khoản lưu trữ Azure bị cấu hình sai được tiết lộ. Vào tháng 7 năm 2022, JUMPSEC Labs đã công bố một tình huồng mà hacker có thể tận dụng các tài khoản như vậy để truy cập vào môi trường trên cơ sở của doanh nghiệp.

Sự việc này là sai lầm bảo mật mới nhất tại Microsoft và xảy ra gần hai tuần sau khi công ty tiết lộ rằng các hacker đã có thể xâm nhập vào hệ thống của công ty và đánh cắp key bí mật rất nhạy cảm bằng cách xâm phạm vào tài khoản doanh nghiệp của một kỹ sư và có khả năng truy cập vào một bản sao dự phòng của hệ thống .

"Trí tuệ nhân tạo mở ra tiềm năng lớn cho các công ty công nghệ. Tuy nhiên, khi các nhà khoa học dữ liệu và kỹ sư chạy đua để đưa các giải pháp trí tuệ nhân tạo mới vào sản xuất, lượng dữ liệu khổng lồ mà họ xử lý đòi hỏi kiểm tra bảo mật và biện pháp bảo vệ bổ sung" - Ami Luttwak, CTO và người sáng lập Wiz cho biết.

"Công nghệ AI mới nổi này đòi hỏi các tập dữ liệu lớn để đào tạo. Với nhiều nhóm phát triển cần xử lý lượng dữ liệu lớn, chia sẻ nó với đồng nghiệp hoặc hợp tác trong các dự án mã nguồn mở công cộng, các trường hợp như của Microsoft ngày càng khó để theo dõi và phòng tránh".

Vụ rò rỉ được phát hiện trên kho lưu trữ AI GitHub của công ty và có thể đã bị công khai khi một kho chứa data model mã nguồn mở được công bố. Dữ liệu bị lộ lọt cũng bao gồm một bản sao lưu đĩa máy tính cá nhân của hai cựu nhân viên chứa các thông tin bí mật, key, password và hơn 30.000 tin nhắn nội bộ trong Teams. Kho lưu trữ này có tên "robust-models-transfer" hiện không còn khả dụng nữa.

"Vụ lộ lọt xảy ra do tính năng phân quyền token SAS trên Azure cho phép người dùng chia sẻ dữ liệu một cách khó theo dõi và khó thu hồi" - các chuyên gia cho biết. Vấn đề này đã được báo cáo cho Microsoft vào ngày 22 tháng 6 năm 2023.

Cụ thể, tệp README.md của kho lưu trữ hướng dẫn các nhà phát triển tải các mô hình từ Azure Storage URL đã cho phép truy cập vào toàn bộ tài khoản lưu trữ, từ đó làm lộ lọt dữ liệu riêng tư.

"Ngoài phạm vi truy cập quá phân quyền, mã thông báo cũng đã được cấu hình sai để cho phép quyền "kiểm soát đầy đủ" thay vì chỉ quyền đọc" - các nhà nghiên cứu nói thêm - "Nghĩa là, một kẻ tấn công không chỉ có thể xem tất cả các tệp trong tài khoản lưu trữ, mà còn có thể xóa và ghi đè lên các tệp hiện có".

Microsoft cho biết họ không tìm thấy bất kỳ dấu vết nào về việc dữ liệu của khách hàng đang bị tiết lộ trái phép và "không có các dịch vụ nội bộ khác nào bị đe dọa do vấn đề này". Họ cũng nhấn mạnh rằng khách hàng không cần thực hiện bất kỳ hành động nào để bảo vệ mình khỏi các cuộc tấn công.

Microsoft cũng lưu ý rằng họ đã thu hồi mã SAS và chặn tất cả quyền truy cập từ bên ngoài vào tài khoản lưu trữ. Vấn đề đã được giải quyết hai ngày sau khi được tiết lộ.

Để giảm thiểu các rủi ro tương tự trong tương lai, hãng đã mở rộng dịch vụ quét mã thông báo bí mật bao gồm bất kỳ mã thông báo SAS nào có thời gian hết hạn hoặc quyền hạn quá phân quyền.

Các nhà nghiên cứu cho hay: "Do việc thiếu bảo mật và quản trị đối với các mã thông báo Account SAS, chúng nên được coi là nhạy cảm như chính khóa tài khoản. Do đó, nên tránh sử dụng Account SAS cho việc chia sẻ công khai. Những sai sót trong việc tạo mã thông báo có thể không được phát hiện và dẫn đến tiết lộ dữ liệu nhạy cảm."

Đây không phải lần đầu mà các tài khoản lưu trữ Azure bị cấu hình sai được tiết lộ. Vào tháng 7 năm 2022, JUMPSEC Labs đã công bố một tình huồng mà hacker có thể tận dụng các tài khoản như vậy để truy cập vào môi trường trên cơ sở của doanh nghiệp.

Sự việc này là sai lầm bảo mật mới nhất tại Microsoft và xảy ra gần hai tuần sau khi công ty tiết lộ rằng các hacker đã có thể xâm nhập vào hệ thống của công ty và đánh cắp key bí mật rất nhạy cảm bằng cách xâm phạm vào tài khoản doanh nghiệp của một kỹ sư và có khả năng truy cập vào một bản sao dự phòng của hệ thống .

"Trí tuệ nhân tạo mở ra tiềm năng lớn cho các công ty công nghệ. Tuy nhiên, khi các nhà khoa học dữ liệu và kỹ sư chạy đua để đưa các giải pháp trí tuệ nhân tạo mới vào sản xuất, lượng dữ liệu khổng lồ mà họ xử lý đòi hỏi kiểm tra bảo mật và biện pháp bảo vệ bổ sung" - Ami Luttwak, CTO và người sáng lập Wiz cho biết.

"Công nghệ AI mới nổi này đòi hỏi các tập dữ liệu lớn để đào tạo. Với nhiều nhóm phát triển cần xử lý lượng dữ liệu lớn, chia sẻ nó với đồng nghiệp hoặc hợp tác trong các dự án mã nguồn mở công cộng, các trường hợp như của Microsoft ngày càng khó để theo dõi và phòng tránh".

Theo The Hacker New

Chỉnh sửa lần cuối bởi người điều hành: